Comment j'ai renforcé mon architecture réseau après une importante violation de données

(How I Hardened My Network Architecture After a Major Data Breach)

20 minute lu Découvrez des stratégies efficaces pour renforcer votre architecture réseau après une violation de données, notamment les leçons tirées et des améliorations pratiques de la sécurité. (0 Avis)

Comment j'ai renforcé mon architecture réseau après une violation majeure de données

Le sentiment d'effroi qui suit la découverte d'une violation de données est impossible à oublier. Pendant des années, je pensais que notre architecture réseau était robuste, à jour et sécurisée. Mais cette illusion a été brutalement brisée lors d'une nuit tardive lorsque nous avons détecté la violation — des centaines de milliers d'enregistrements sensibles exposés. Après que l’analyse post-mortem et le chaos de la réponse à l’incident se soient calmés, j’ai dû admettre une vérité peu réjouissante : la posture de sécurité de notre réseau n’était ni complète ni pérenne. Voici une description franche de la manière dont j’ai repensé notre architecture, en y ajoutant de la profondeur, de la transparence et de la résilience.

Repenser la sécurité du périmètre

La violation a révélé une fausse sensation de sécurité alimentée par des défenses traditionnelles axées sur le périmètre, comme les pare-feu et les VPN. Les attaquants se sont faufilés, exploitant des identifiants privilégiés et des tactiques de mouvement latéral — tandis que notre surveillance se concentrait uniquement sur les points d'entrée.

- Segmentation du réseau : Inspiré par le concept de zéro-trust, j’ai segmenté le trafic réseau en utilisant des VLAN et des ACL robustes (Listes de Contrôle d’Accès). Au lieu d’un réseau plat où prod, dev et les PC de bureau co-minglaient, des frontières strictes ont été imposées.

- Micro-Segmentation : En s’appuyant sur des outils tels que VMware NSX, nous avons construit des micro-segments autour des charges de travail critiques. L’accès entre les segments n’était autorisé que par le besoin strict et était continuellement enregistré.

- Renforcement des passerelles de périmètre : Nos pare-feu ont été modernisés, utilisant des capacités adaptées aux applications avec détection/prévention d’intrusions (IDS/IPS), géo-clôture, et blocage automatique des menaces.

Constat concret : En examinant les journaux, j’ai constaté que le mouvement latéral des attaquants restait non détecté essentiellement en raison du trafic Est-Ouest ouvert. Après la segmentation, les attaques tests (avec des exercices Red Team) ont montré que les attaques directes étaient automatiquement contenues dans des segments plus petits, isolant efficacement les menaces.

Mise en œuvre des principes Zero Trust

Les mots à la mode fusent souvent, mais après la violation, « Zero Trust » est devenu une lumière directrice. Aucun utilisateur, appareil ou paquet n'était exempt d'authentification ou d'autorisation — quel que soit son emplacement.

- Accès axé sur l'identité : Tant les utilisateurs que les charges de travail nécessitaient des identités vérifiées. Nous avons déployé une authentification multi-facteur forte (MFA) partout, pas seulement pour l’accès VPN. L'authentification unique (SSO) était sécurisée par une authentification basée sur des certificats.

- Accès au strict minimum : Le contrôle d’accès basé sur les rôles (RBAC) et l’élévation des privilèges juste-à-temps sont devenus la norme. Les employés ne pouvaient pas détenir des privilèges administratifs indéfiniment.

- Assurance continue : Le comportement des sessions était surveillé en continu. Les sessions suspectes — comme un utilisateur se connectant depuis deux zones géographiques — déclenchaient immédiatement le verrouillage automatique.

Exemple : Pour illustrer l’impact : le compte d’un entrepreneur compromis par phishing a tenté un mouvement latéral, mais les contrôles Zero Trust ont bloqué l’accès aux segments de production restreints. Autrefois, cela aurait probablement passé inaperçu.

Défense en couches : au-delà de l’ordinaire

Un seul contrôle défensif est un seul point de défaillance. Inspiré par le mantra « Defense in Depth », j’ai investi dans des contrôles variés à chaque couche possible.

- Protections basées sur l’hôte : Détection et réponse sur les points de terminaison (EDR), comme CrowdStrike ou SentinelOne, ont été déployées sur les ordinateurs portables, serveurs et même les conteneurs DevOps.

- Gestion des correctifs : La violation avait tiré parti d’un serveur interne non patché. Des outils de correctifs automatisés (par exemple WSUS, Ansible, outils intégrés du système d’exploitation) ont veillé à ce qu’aucun appareil ne traîne sans mises à jour de sécurité.

- Trafic chiffré partout : Tous les API internes, bases de données et communications utilisaient le chiffrement TLS 1.2+.

- Sécurité dans le Cloud et SaaS : Pare-feux d'applications Web (WAF) et passerelles API sécurisées protégeaient les données dans les charges de travail cloud, comblant des backchannels faciles à manquer.

Résultat : Après la mise en œuvre, un test d'intrusion externe a démontré que les tentatives d’élévation de privilèges et de propagation latérale avaient été contrecarrées, confirmant le succès des contrôles en couches.

Amélioration de la visibilité réseau et de la journalisation

À la suite de la violation, l’absence de visibilité fiable et exploitable s’est avérée cripplante. Nous sommes passés de simples dumps de journaux à un écosystème de surveillance sophistiqué et consultable.

Actions déployées :

- Tableaux de bord SIEM : Déploiement de Splunk pour l’agrégation en temps réel de tous les journaux : pare-feu, EDR, applications et activité des utilisateurs. Des règles de corrélation personnalisées signalaient des motifs suspects.

- Capture complète de paquets : Sur les segments réseau sensibles, nous avons activé la capture du contenu des paquets sur une fenêtre glissante de deux semaines.

- Inventaire des actifs et alertes : Maintenu des inventaires en direct de chaque point de terminaison et appareil réseau afin de repérer des anomalies telles que des équipements non autorisés.

Exemple détecté : Cette nouvelle visibilité a révélé des appareils IoT non autorisés qui s’étaient auparavant fondus dans le bruit de fond. Les ACL les ont bloqués et les politiques mises à jour.

Développement des protocoles de réponse aux incidents

Ayant vécu le chaos et la confusion d’une violation réelle, l’élaboration de plans de réponse aux incidents disciplinés et bien répétés était non négociable.

Éléments clés :

- Playbooks détaillés : Chaque scénario d’attaque — ransomware, vol d’identifiants, DDoS — a reçu un playbook personnalisé, tenu à jour et testé chaque trimestre.

- Confinement automatisé : Des contrôles EDR et pare-feu intégrés pouvaient instantanément isoler ou bloquer des points de terminaison suspects selon les déclencheurs d’alerte.

- Matrices RACI : Nous avons attribué des rôles clairs (R, A, C, I), de sorte qu’aucune tâche ne soit oubliée ou répétée dans l’effervescence de la réponse à l’incident.

- Schéma de communication : Mise en place de canaux pour les reporters (utilisateurs, fournisseurs), les répondants (SOC, IT, externes) et les notifications au niveau exécutif, y compris les aspects juridiques et RP.

Exercice sur table : les exercices ont démontré les bénéfices immédiats : incidents gérés calmement, indicateurs rassemblés de manière systématique, et plus de confusion sur les responsabilités internes.

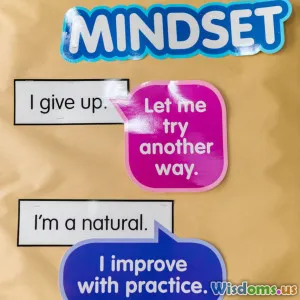

Construire une culture d'équipe axée sur la sécurité

L’architecture seule ne suffit pas à sécuriser un réseau ; ce sont les gens qui le font. Les techniques des attaquants évoluent chaque jour, et seule une équipe vigilante et bien informée peut s’adapter aussi rapidement.

Ce qui a changé :

- Formation obligatoire à la sensibilisation à la sécurité : Passée de modules annuels mécaniques à des exercices virtuels mensuels basés sur des scénarios et des tests de phishing.

- Transparence : Maintenu le personnel informé des victoires en matière de sécurité et des quasi-accidents pour instaurer la responsabilité, pas une culture de blâme.

- Récompense de la vigilance : Globalement, les membres de l’équipe qui ont repéré des tentatives de phishing ou signalé des bogues tôt ont été récompensés — pas seulement par des remerciements mais aussi par des micro-incitations.

Récit marquant : Après notre refonte, un administrateur a remarqué, signalé et stoppé une tentative potentielle d’exfiltration de données (activité anormale sur un bucket S3) en quelques minutes, quelque chose qui avait été manqué auparavant.

Évaluation des menaces émergentes et amélioration continue

Aucune architecture n’est statique — c’est un processus vivant. Plus je lis des rapports post-violation et plus je surveille les flux de renseignement sur les menaces, plus j’insiste pour que notre réseau devienne adaptable.

Processus mis en place :

- Red Teaming régulier : Des équipes internes et externes ont mené des simulations adverses régulières centrées sur des actifs commerciaux critiques.

- Intégration du renseignement sur les menaces : Connecté à des flux commerciaux et open-source (comme Recorded Future, MITRE ATT&CK et les alertes CISA) pour des mises à jour de configuration en temps réel dans les outils préventifs.

- Politiques de gestion du changement : Tous les changements — qu’il s’agisse d’ajustements IAM ou de déploiements d’endpoints — nécessitaient une analyse des risques et des revues par les pairs.

Application dans la vie réelle : Un exemple réel : après des avis concernant une attaque de chaîne d’approvisionnement sur un fournisseur SaaS tiers, nous avons rapidement examiné et segmenté les intégrations, bloqué des accès de données excessifs et imposé des permissions strictes pour le trafic sortant.

Tirer parti de l'automatisation et de l'orchestration

Les processus manuels — lents et sujets aux erreurs — n’avaient pas leur place dans notre architecture renouvelée. J’ai adopté l’automatisation des flux de travail non seulement pour soulager le personnel, mais aussi pour prendre de vitesse les attaquants.

Outils utilisés :

- Plateformes SOAR : Plateformes d’orchestration, d’automatisation et de réponse (SOAR) ont automatisé le triage des incidents, la chasse aux menaces à travers les journaux et même les remédiations d’incidents de base.

- Remédiation scriptée : Scripts PowerShell et Python appliquaient automatiquement les politiques de sécurité (tels que le téléversement des journaux ou les ajustements des règles de pare-feu), réduisant les erreurs humaines.

- Auto-provisionnement : Les nouveaux appareils, services ou conteneurs rejoignaient le réseau uniquement après des contrôles de conformité automatiques et une configuration de référence issue du contrôle de version — une approche GitOps pour la sécurité de l'infrastructure.

Bénéfices clés : Les temps de réponse ont chuté de manière spectaculaire. Dans une simulation de violation, un logiciel malveillant sur un poste de travail a été détecté, isolé et l’utilisateur informé — sans aucune intervention manuelle — en 48 secondes.

Renforcement de la sécurité des tiers et de la chaîne d'approvisionnement

La violation provenait d’un fournisseur compromis disposant d’un accès réseau bien trop généreux. Le risque lié aux tiers est devenu ma prochaine frontière.

Éléments ajoutés :

- Due diligence des fournisseurs : Examens réguliers obligatoires de sécurité pour tous les fournisseurs. Les équipes internes évaluaient la maturité et la conformité des fournisseurs avant le renouvellement des contrats.

- Segregation réseau : Aucun compte tiers n’obtenait de nouveau un accès à l’environnement entier. Les connexions étaient segmentées, temporaires et surveillées de façon exhaustive.

- Intégrations API sécurisées : Application stricte OAuth2, JWT ou mTLS pour tout appel API entrant ou sortant, avec des permissions fines.

- Protections juridiques : Les termes SLA de sécurité incluaient des exigences de notification, des droits d’audit et des recours en responsabilité en cas de négligence du partenaire.

Leçon appliquée : Un fournisseur SaaS autrefois fiable présentant une vulnérabilité critique a été rapidement segmenté et son accès révoqué jusqu’à ce que des preuves de correctifs et une nouvelle évaluation soient fournies.

Implémentation des pratiques DevSecOps sécurisées

La sécurité se déplace vers la gauche — intégrée à chaque étape, et non ajoutée à la hâte. Notre violation a inclus l’exfiltration de données de bases via du code d’application compromis ; le DevSecOps est devenu essentiel après la violation.

Initiatives concrètes :

- Tests de sécurité automatisés : Ajout du SAST (Static Application Security Testing) et du DAST (Dynamic) dans nos pipelines CI/CD, bloquant les déploiements lors de la découverte de vulnérabilités critiques.

- Relectures de code et gestion des secrets : Des revues entre pairs ont mis en évidence des dépendances peu sûres, et des outils de balayage des secrets ont empêché la fuite de clés API ou d’identifiants dans des artefacts déployables.

- Infrastructure immuable : Déploiement de charges de travail basées sur des conteneurs pour faciliter le rollback et limiter le décalage entre les environnements, en tirant parti de l’infrastructure as code.

Résultats immédiats : Une vérification de pipeline routinière a empêché un commit de code involontaire exposant des clés AWS, évitant une compromission potentielle massive.

Mesure et reporting de la posture de sécurité

La responsabilité alimente la sécurité. Aucune amélioration n’est complète sans mesure, et l’adhésion des cadres nécessite des preuves continues et transparentes.

Comment je l’ai abordé :

- Tableaux de bord : Des tableaux de bord de visualisation prêts pour la direction ont montré des KPI en temps réel : tentatives d’intrusion, vulnérabilités corrigées, temps moyen de détection (MTTD), temps moyen de réponse (MTTR).

- Vérifications de conformité : Cartographie des contrôles sur des standards (NIST CSF, ISO 27001, SOC2), en utilisant des outils d’audit pour valider que les écarts restaient fermés.

- Revues trimestrielles des parties prenantes : Partage de registres de risques prioritaires, d’exercices d’incidents et d’histoires de réussite — pour étendre le soutien au-delà de l’IT.

Résultat tangible : Après un an, la direction a approuvé une feuille de route axée sur la productivité et la sécurité — une approbation qui n’aurait pas été imaginable sans données claires.

Évaluer la publication

Avis des utilisateurs

Autres publications dans Cybersécurité

Publications populaires